Первые реальные тесты RTX 4080: мощная, но чрезмерно дорогая модель

Сегодня истек запрет на публикацию обзоров RTX 4080 — второй по мощности видеокарты NVIDIA в текущем поколении. На Videocardz собрали все вышедшие обзоры в удобную таблицу, а чуть ниже вы найдете краткую выжимку по результатам.

В Digital Foundry посетовали на то, что RTX 4080 стоит неприлично дорого для карты, превосходящей прошлое поколение не столь уж сильно. RTX 3090 Ti уступает ей в среднем 25%, при этом она и стоит дешевле. Такое впечатление, что NVIDIA «забыла» о прогрессе и просто предлагает чуть лучшую производительность за чуть большие деньги.

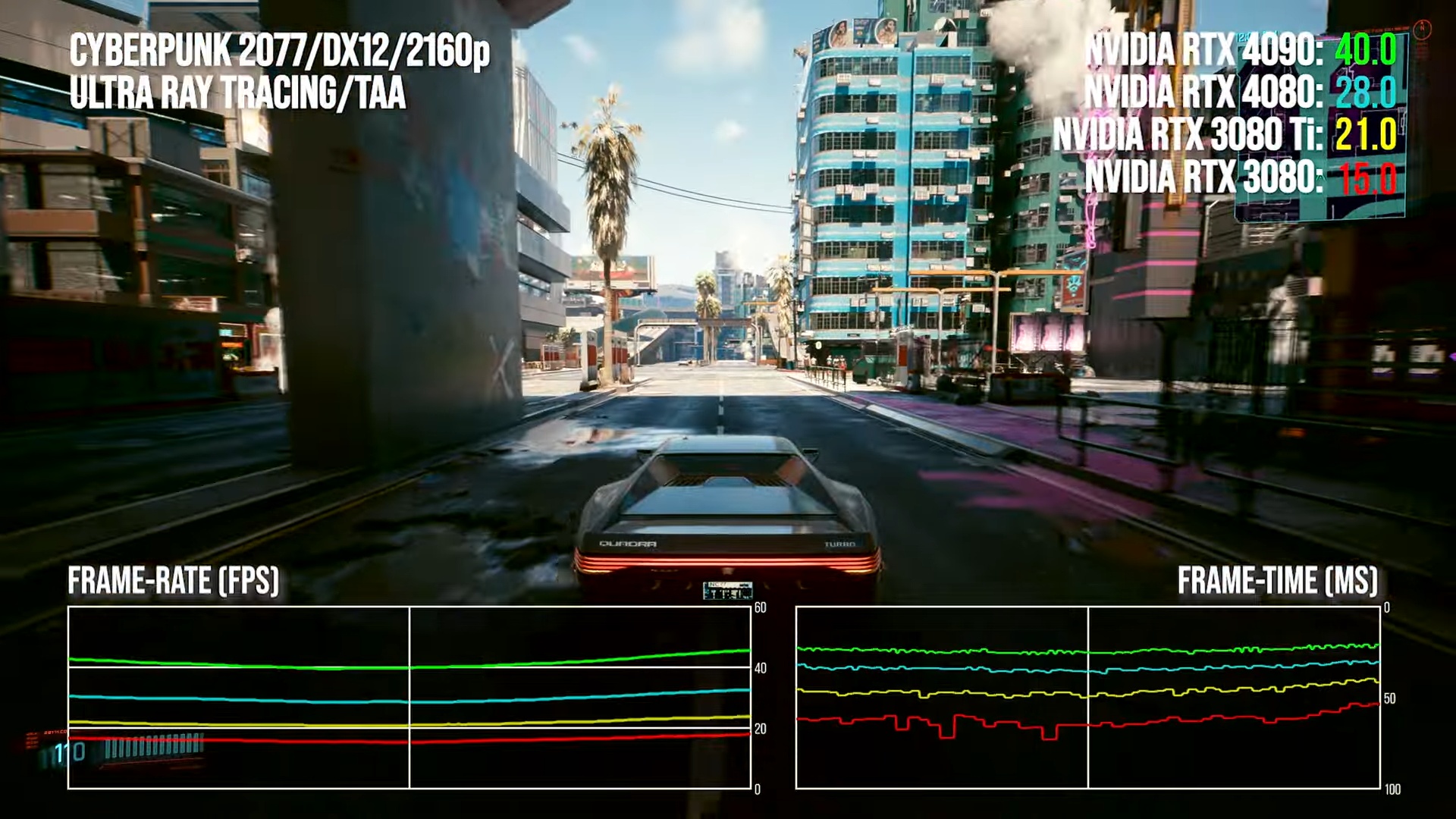

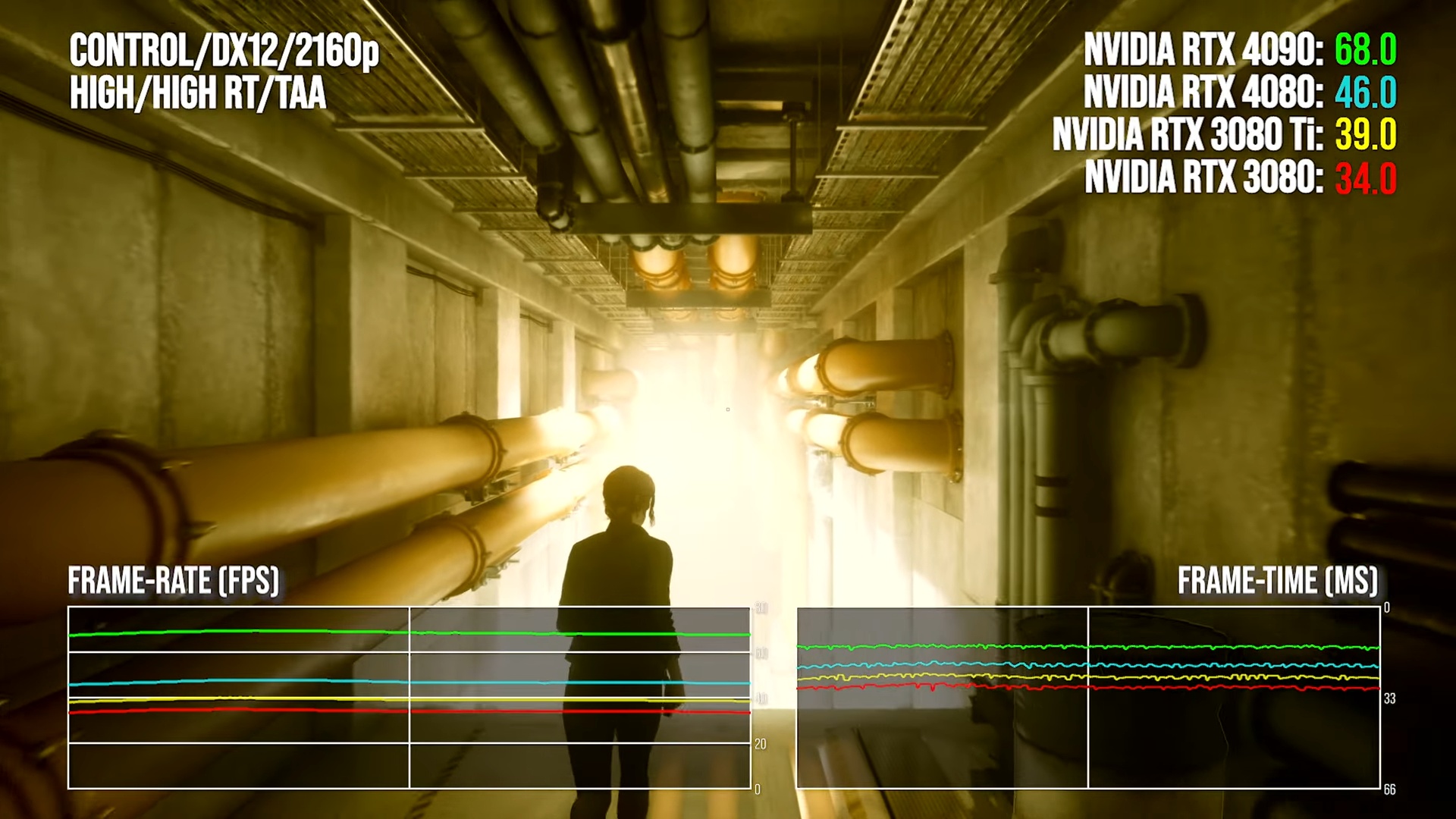

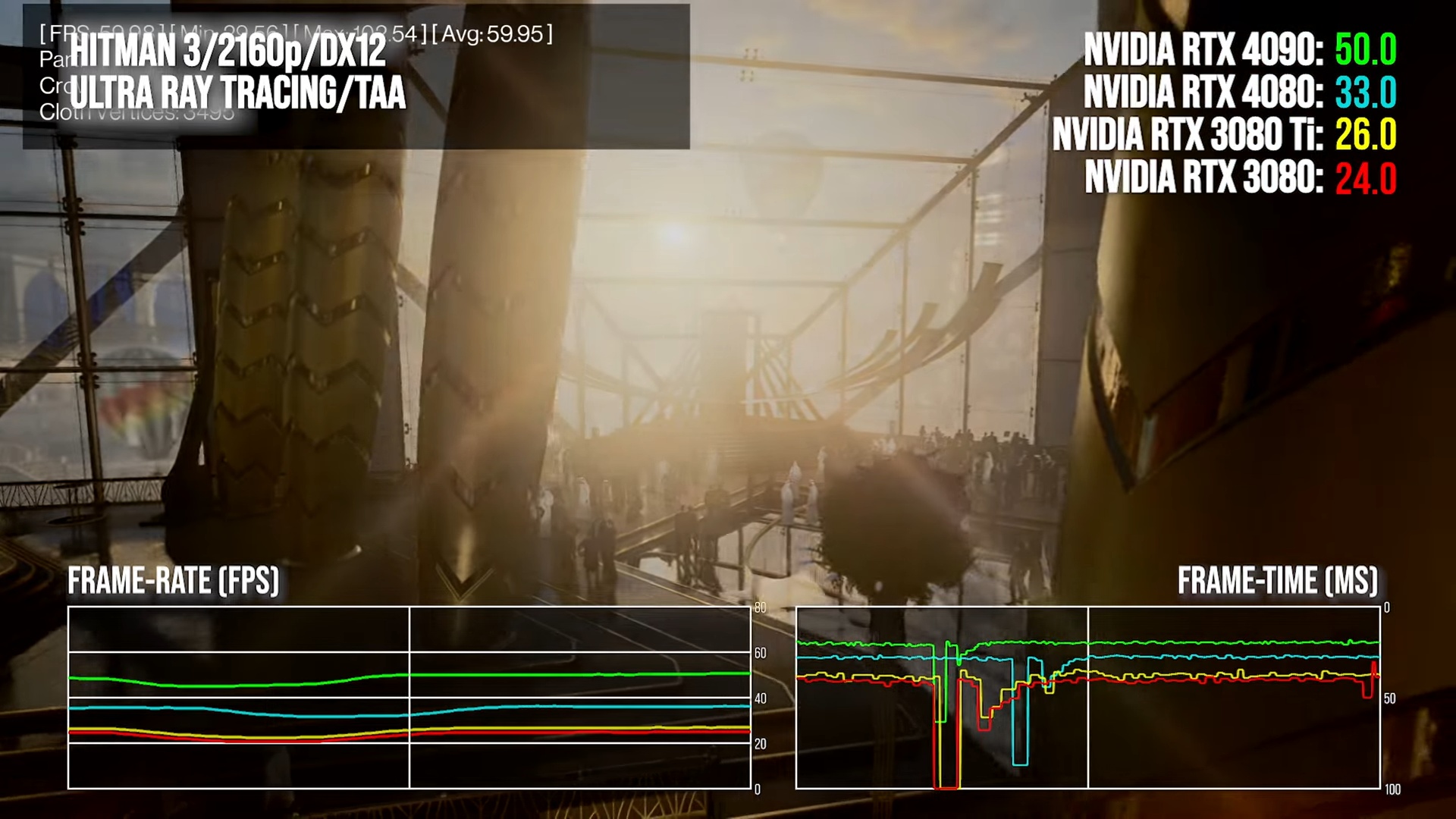

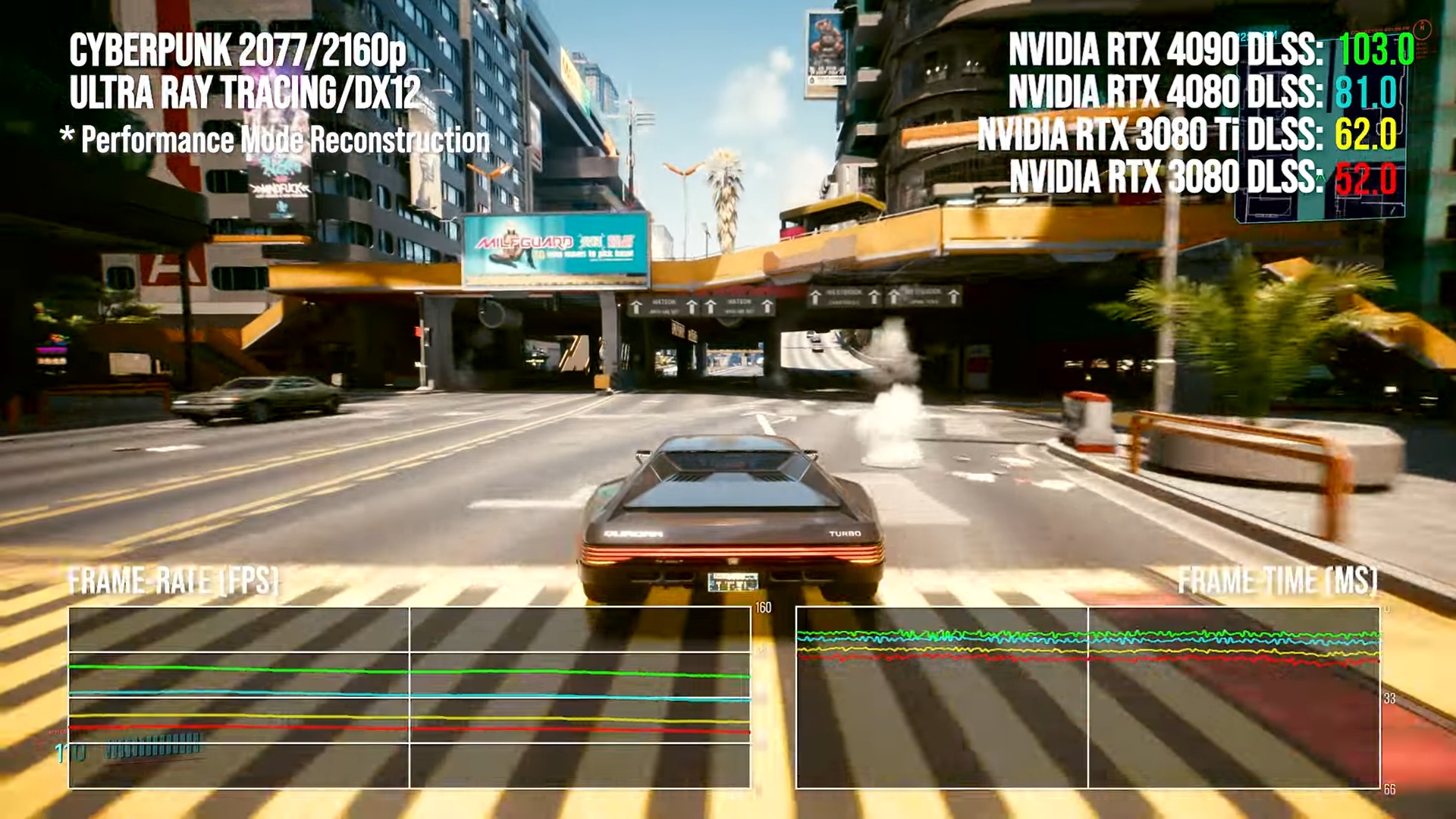

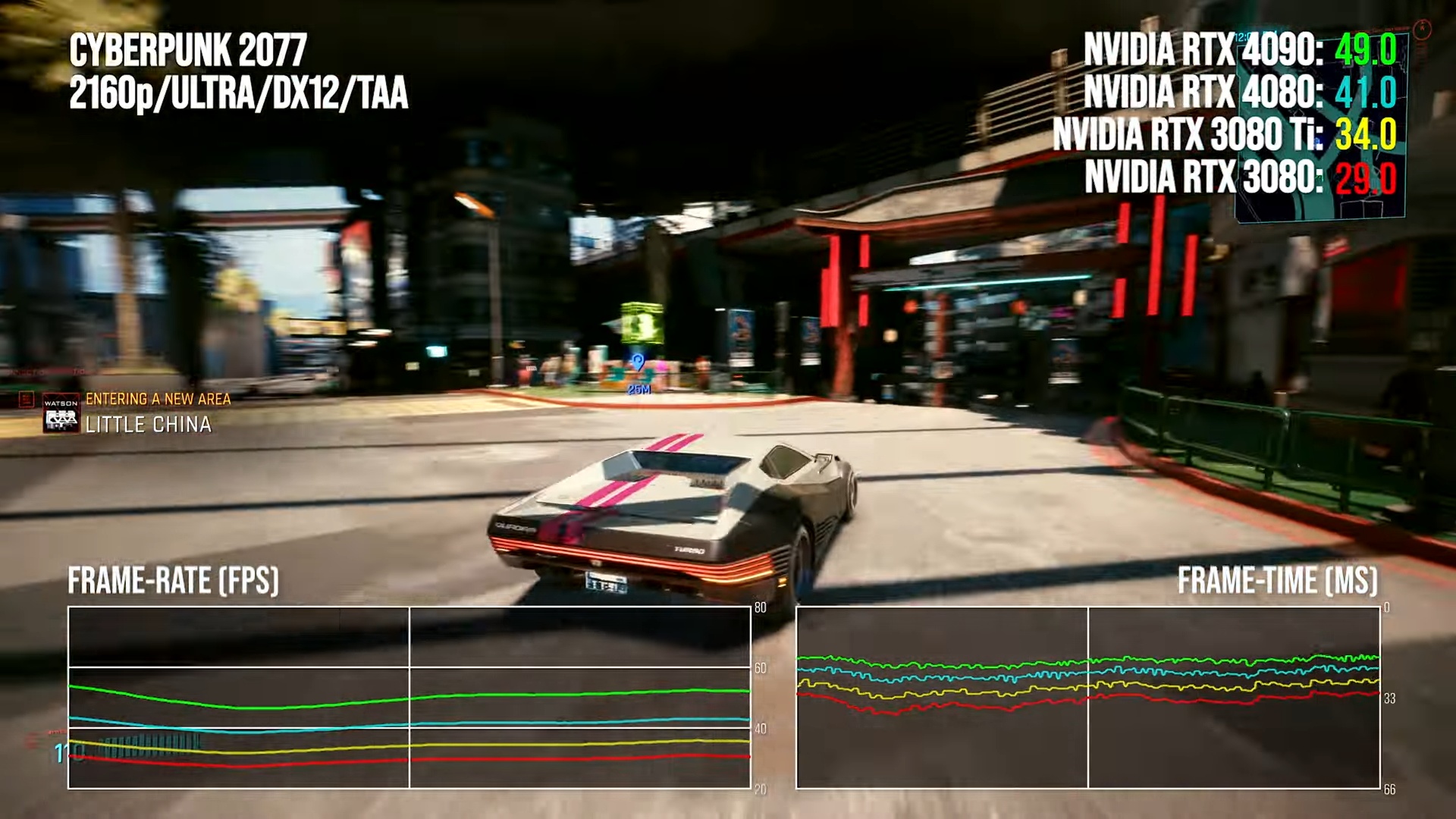

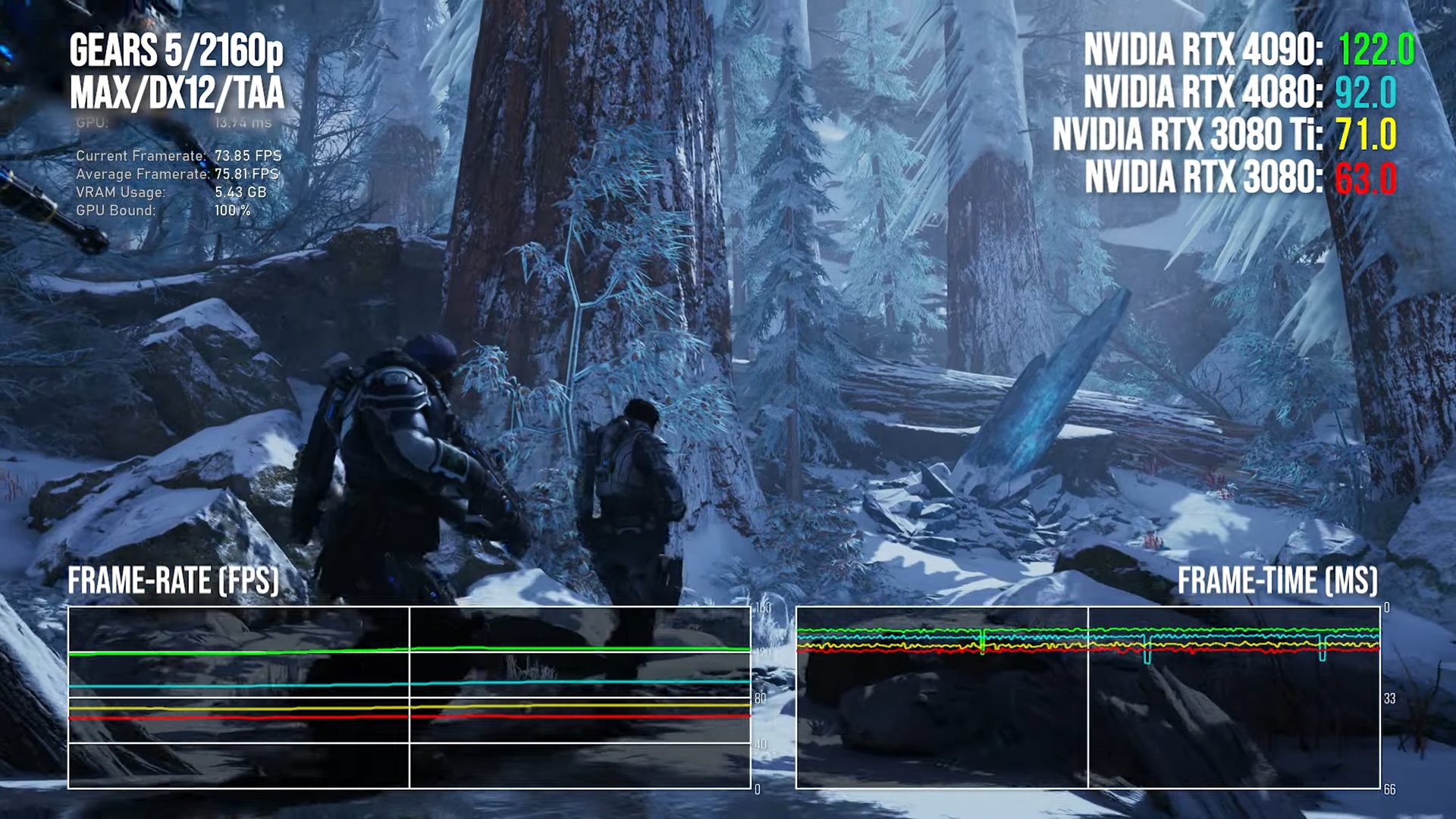

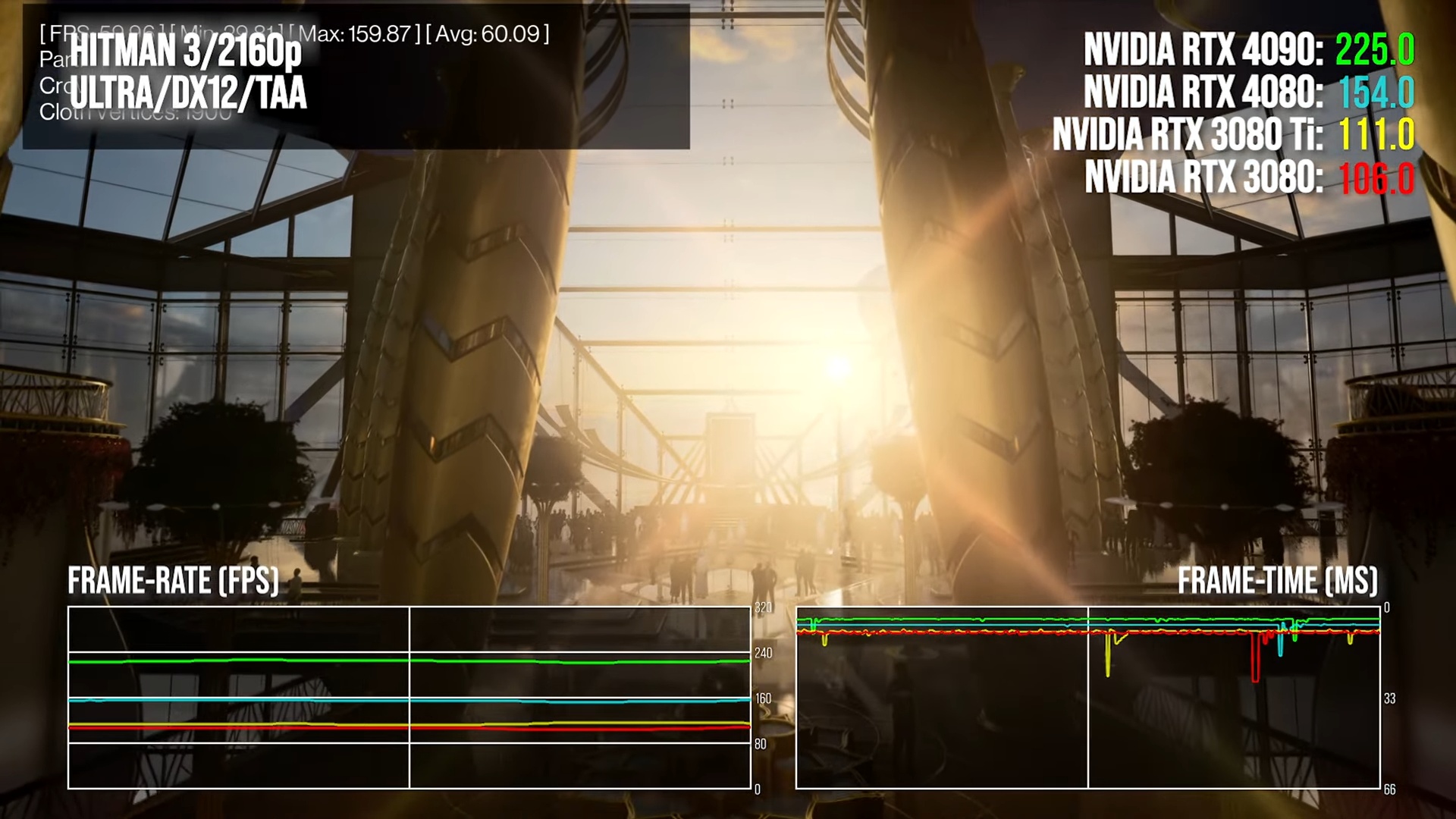

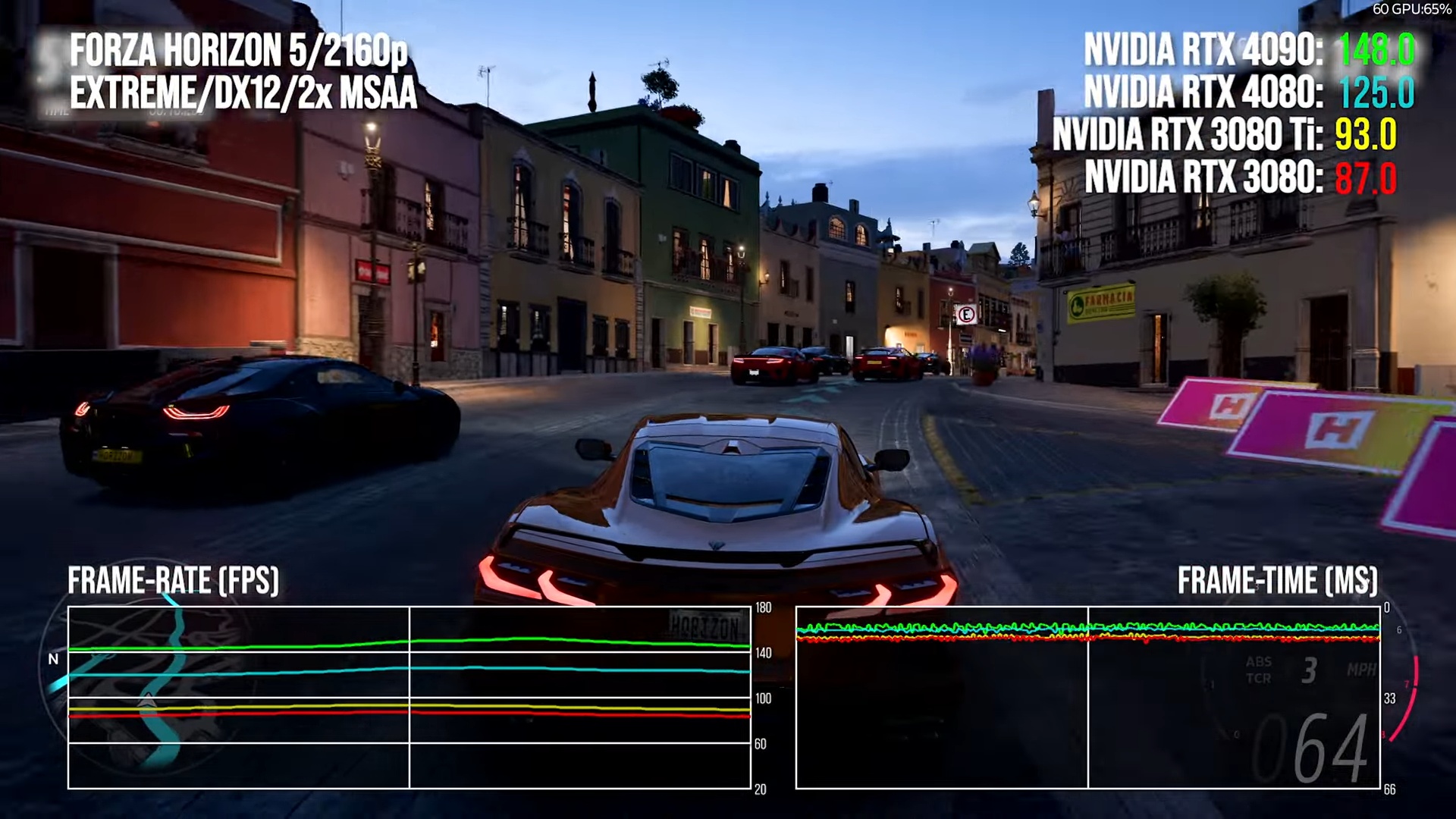

В самой «тяжелой» игре современности — Cyberpunk 2077 — RTX 4080 уступила RTX 4090 примерно 40%, обойдя RTX 3080 Ti на 25-30%.

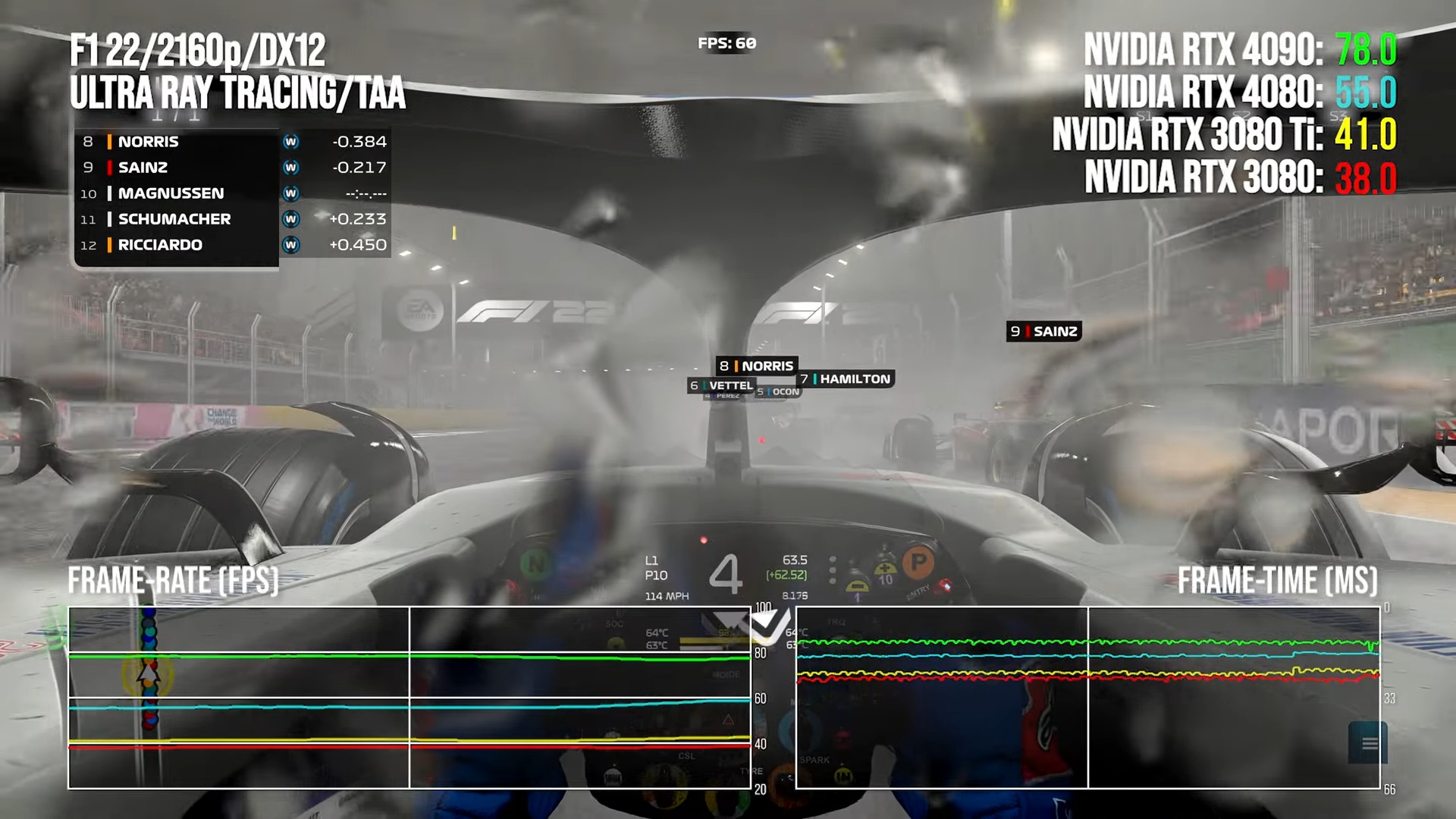

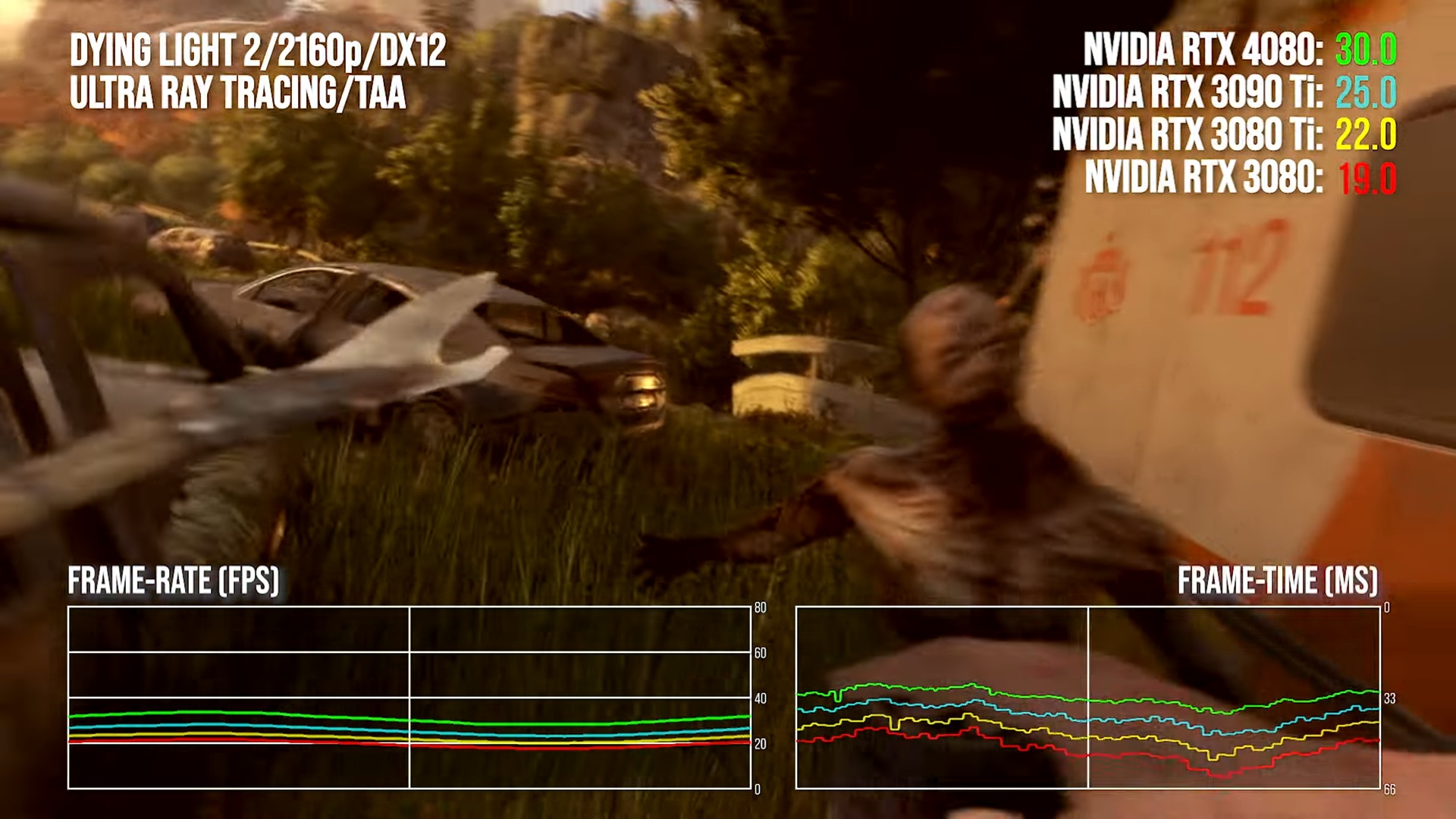

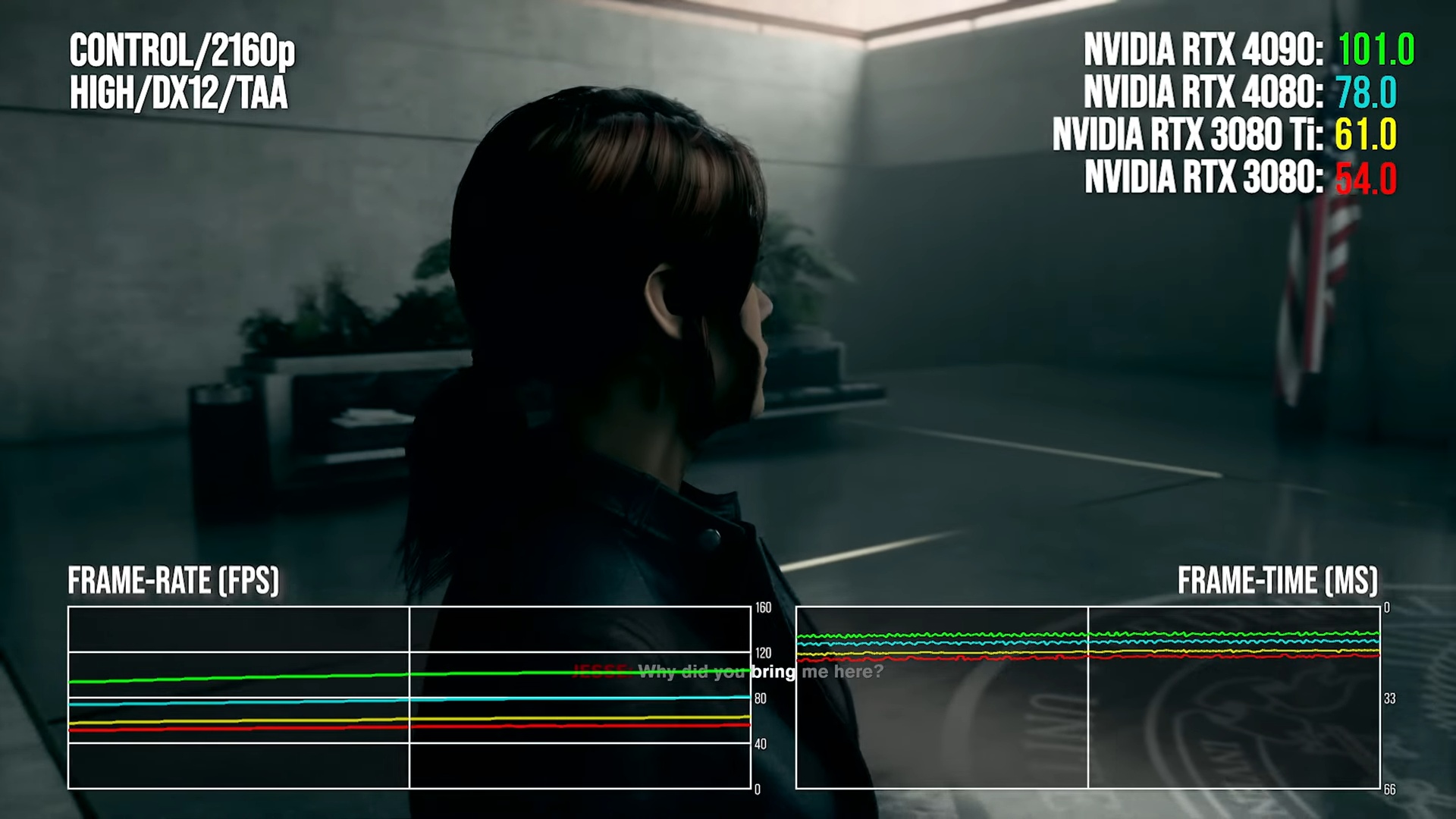

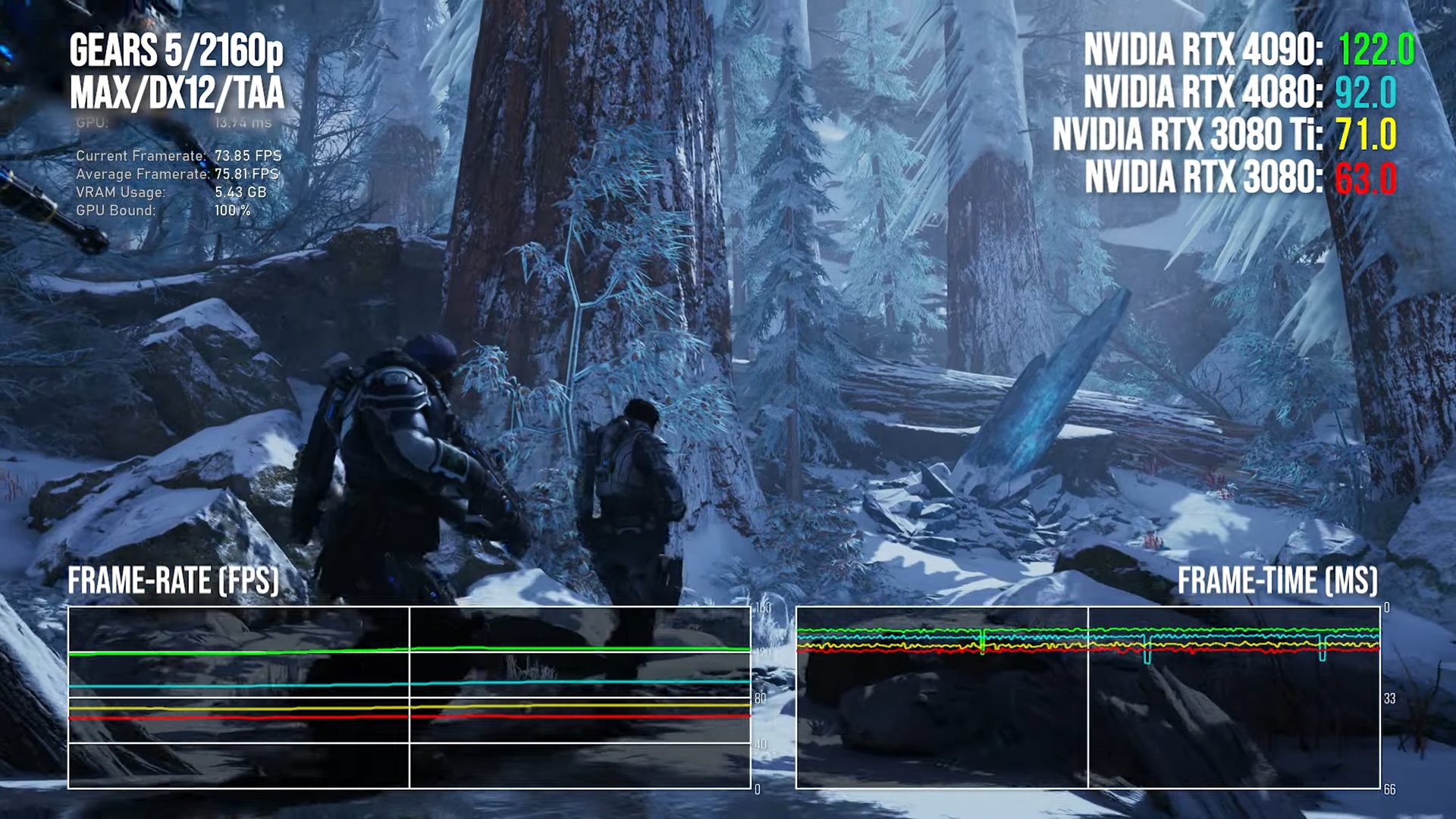

Подобная разница сохраняется и в других протестированных играх. Разве что отставание от RTX 4090 местами вырастает до 50%.

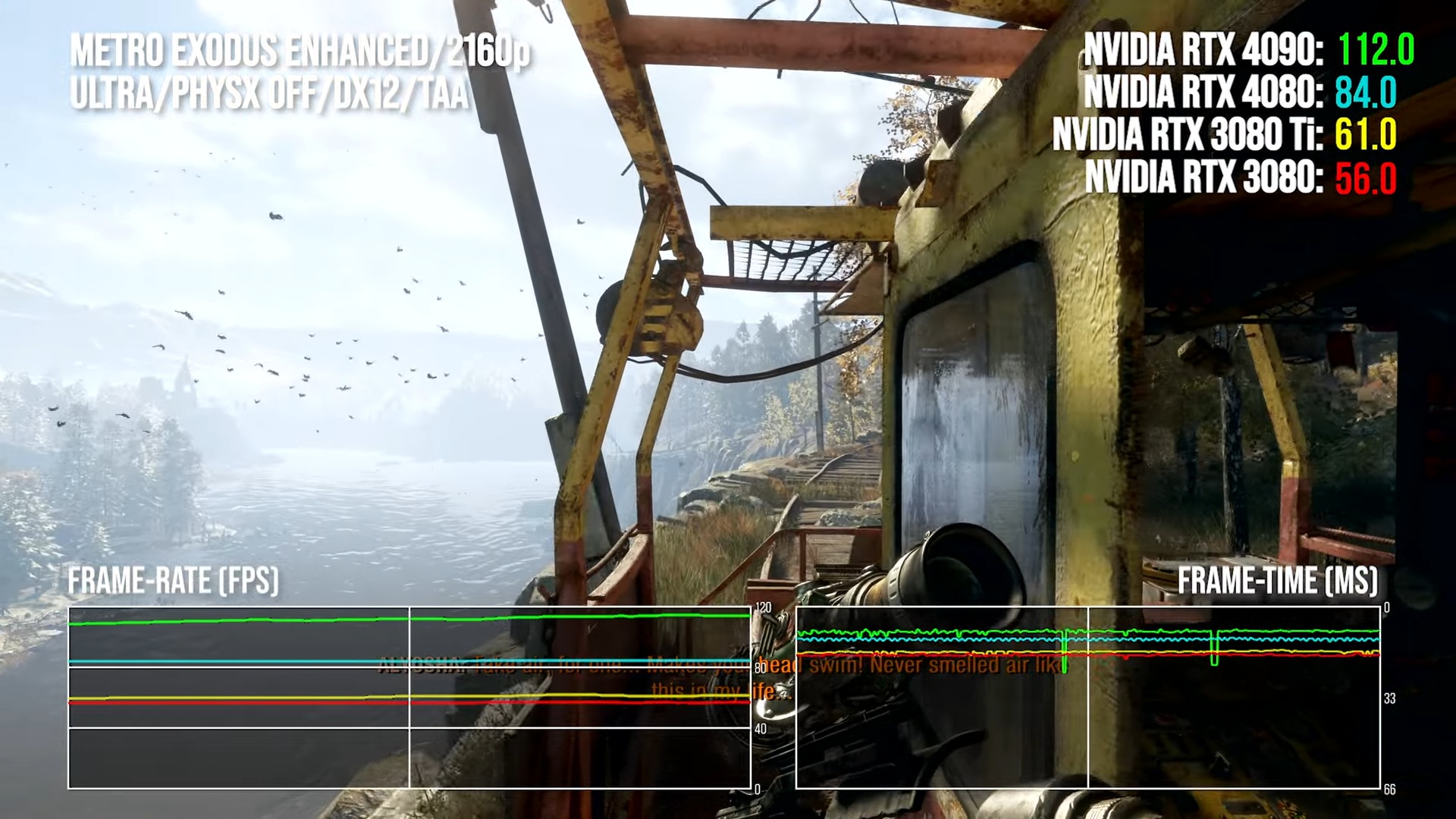

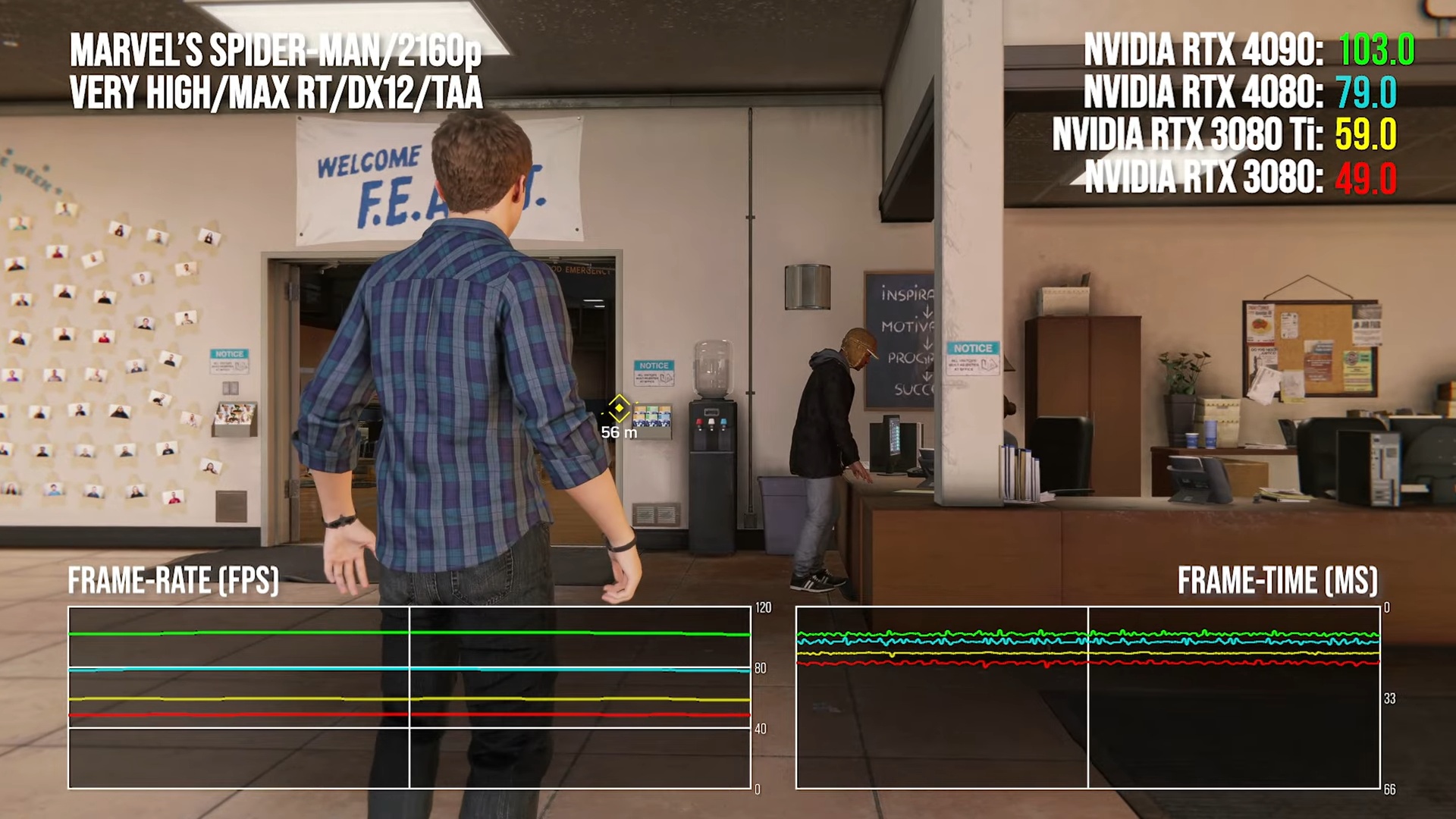

Исключениями стали Metro: Exodus и Marvel’s Spider-Man. В них, судя по всему, RTX 4090 упирается в производительность процессора, так что отрыв не настолько велик.

Поиграть в Cyberpunk 2077 в 4K с трассировкой лучей на RTX 4080 можно только с включением DLSS. Впрочем, и карты предыдущего поколения неплохо справляются с ультра-настройками.

Если же трассировку отключить, то ситуация меняется в лучшую для RTX 4080 сторону. До RTX 4090 в большинстве случаев остается 20-25% отставания.

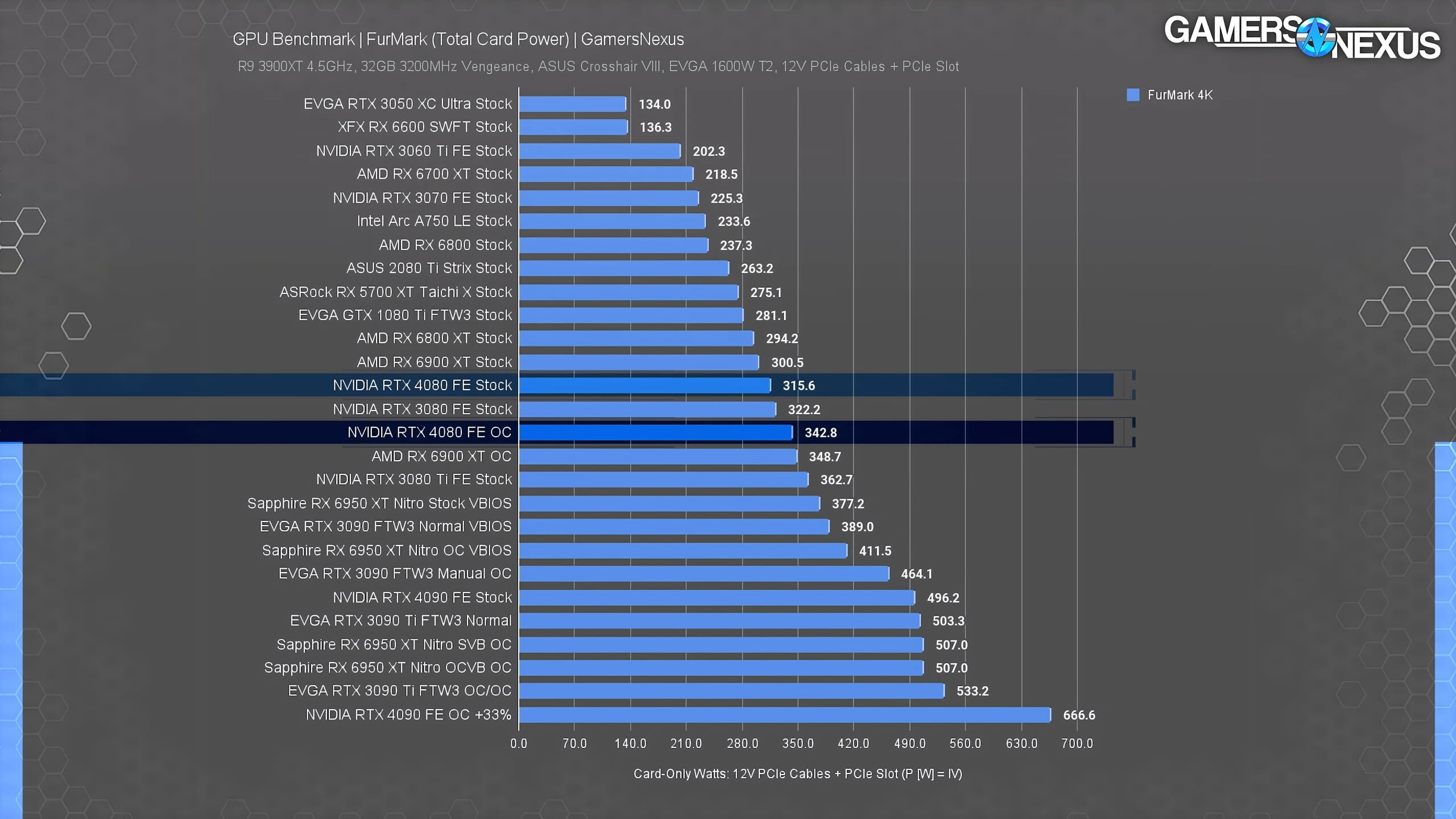

В плане энергопотребления RTX 4080 показала себя хорошо: ПК с ней показал схожие с RTX 3080 результаты. Отрыв от RTX 4090 и RX 6950 XT в тесте Furmark составил почти 200 Вт, в реальных играх — 100-150 Вт.

Обозреватели считают RTX 4080 хорошей видеокартой с завышенной ценой. Особенно высокой она покажется европейцам, где за отдельные модели просят до 1700 евро. В этом случае лучше взять RTX 4090 или любую модель прошлого поколения — они выгоднее по соотношению цены к производительности.

с такими цениками как у NVIIDA, у АМД есть хороший шанс выстрелить

Походу Нвидиа выпустила элитную линеку под видом нового поколения для реальных пацанов, кому надо — тот купит, и принесёт овер прибыль в соотношении себестоимость/наценка. У Нвидиа сейчас задача по важнее, сбыть запасы предыдущего поколения, чем она активно и занимается, снижая ценник на оную, тупо незачем отвлекать народ другим/более выгодным предложением. Скорее всего в следующем поколении Нвидиа развернётся на полную, с псевдо оправданиями “мы всё поняли” и “нас не правильно поняли”.

@romka ну это поколение, явно удачнее прошлого и сильно удачнее 20-ой серии, где-то на уровне 10-ой (не считая цены и прогаров )

)

Цена всё и рушит. Десятая линейка — народная. Двадцатая слишком недалеко откатилось от яблони десятой, плюс RTX не раскрывался. Тридцатая погрязла в глобальном дефиците. И сороковой народность с такими ценами не светит, насколько бы хорошей она не была, по ходу изначально и не планировалось, задача у неё иная.

@romka ну 30-ую распродадут, цены наверное подопустят на 40-ую, может какая-нибудь 4060 ещё станет “народной”.

Цены такие, потому что не планировались 4050-4070. Их роль 3я серия должна была закрывать. Но с переобуванием по 3080 12g не понятно теперь.

Я вообще сейчас куплю 3070 и больше видюхи наверное не буду обновлять. Картинка с ними лучше не становиться и всё больше набирает обороты ретро-гейминг. А ему вообще моей 970-ой хватает

Если не брать во внимание RT, то картинка, что на gtx580, что на 4090, будет одинакова, дело за fps. Будь дело только в картинке, все бы до сих пор сидели на первых dx11 картах

Гейтрейсинг скоро загнется, как загнулось фирменное 3D Vision и не только оно.

Уже третья серия карт с гейтрейсингом, а производительность в нем падает на показатель от 50% даже на RTX 4000. Сейчас еще выручка от игрового сегмента у Nv значительно упала (после пропажи майнинга карты стали нужны на 72% меньше). К тому же близок предел по кремнию. Контора намотает все это на ус, новые карты появятся не раньше, чем через 2 года и будут либо последними гейтрейсинговыми, либо вообще без него.

Печальнее всего то, что больше внимания уделяется сокрытию слабой производительности через засилие технологий снижения разрешения кадра и размыливания. Началось все с мыльных апскейлов DSR, которые мылят как PS3 даже при нулевой “плавности”, а теперь вот все эти DLSS, DLAA и прочее, от использования чего даже на минимуме в режимах качества картинка становится невыносимой. Не отстает и АМУДЕ, но там даже в лучах никакой производительности изначально не было (RX 6000), а старую добрую GTX 1080 они по производительности и стабильности догнали только к серии RX 5000.

GTX 1070 в свое время превосходила GTX 980Ti, а RTX 4080 еле-еле допердывает чуть выше RTX 3090\Ti выдавая, в среднем, на 10-20 кадров больше последней. Похоже, что младшие карты RTX 4000 вообще будут не нужны на фоне существования RTX 3000. Все эти DLSS 3.0, как выяснилось — сугубо программная вещь, которая работает даже на видеоведрах пяти-шестилетней давности без лучей и тензоров, а новые кодировщики с NVENC — не то, чтобы аргументы к покупке.

4080 на фоне 4090 выглядит бессмыссленной для потребления. У нас в рознице она оказалась не 80-100К, а ближе к RTX 4090. Амуде тоже зря времени не теряют и с RX 6000 более или менее научились в маркетинг. Надеюсь, что они решили вечную проблему драйвера еще времен ATI, когда экран в 2D-режиме внезапно отключается и приходится перезагружать комп.

Момент перехода с GTX 900 на GTX 1000 был последней серьезной вехой компании. Рост производительности между последними тремя сериями довольно скромный.

По производительности 1070 была между 980 и 980Ti в тех играх (в большинстве на тот момент), где производительность не упиралась в 6 ГБ видеопамяти 980Ti.

@legusor проблемы с дровами АМД у кого угодно только не у владельцев АМД уже 20 лет как они более стабильны и безглючны чем дно нвидевские

какую дичь в последние недели нвидиа с ними творит. хотя и раньше то ломала старые игры ААА РДР2 полгода чинила, да че там игры, проигрывание видео ютуба в хроме чинила 8 месяцев гсинк свой родной аппаратный причем не могли починить тоже полгода, более глючная компания только интел, тему даже русскоязычную читаешь и плачешь — https://forums.overclockers.ru/viewtopic.php?p=17825271#p17825271

гсинк свой родной аппаратный причем не могли починить тоже полгода, более глючная компания только интел, тему даже русскоязычную читаешь и плачешь — https://forums.overclockers.ru/viewtopic.php?p=17825271#p17825271

Ой, приукрашивать-то не надо, а чё не 30-ть лет?

Я до сих пор на 2060 сижу и не понимаю, зачем я её взял, если 90% времени она тупо простаивает

ну это фактически правда… лет 20 активно использую Радеонки (обычно от Асуса) и нет никаких проблем с драйверами, а до этого регулярно ловил краши в системе, правда тут сложно сказать — винда глючили или драйвера.

* ну пусть даже будет там погрешность в 2-3 года, особо смысла не меняет.

вот тоже сижу и думаю нафига нужны современные супер видюхи…

новые игры — дрянь в основном, играть не хочется. А то , что по настоящему интересно — таких мощностей не требует)

Одно время занимался ремонтом ноутбуков, частенько именно для AMDшных чипов приходилось придумывать различные костыли, не говоря уж про наибольший процент по перегреву по сравнению с зелёными.

@CyberBear но ведь они делаются на одних и тех же заводах, ни у нвидии ни у амд нет собственного производства, как же так?

А чё она творит то? Я что-то пропустил?

Нет, не загнется (ИМХО) … если даже “конкуренты” в лице АМД пытаются “копировать” эти возможности. Если бы загибалось, они бы даже внимание не обратили.

Они нужны когда меняешь монитор 1080р\1440р на более скоростной (типа 144+ гц), 4к+ и т.п.

Сказочный, он всегда будет, сравнивать с отдельной гарнитурой вроде 3D Vision Глупо, тесселяция тоже когда то страдала в фпс как и хаирворкс но потом всё вылечили, правда времени меньше понадобилось, а ретрейсинг будут до конца колупать до оптимального фпс, и разработчики не откажутся от него так как кучу времени экономит на освещение

ОЧЕНЬ жирно. Такого говна, как AMD Software, ещё поискать.

Выпускала обычные обновления. Чувак просто троллит.

Делаются на одних, а разрабатываются инженерами каждые сидят в своей конторе